18 Feltáró faktorelemzés (Exploratory Factor Analysis)

A fejezet megértéséhez a főkomponens-elemzésről fejezetben tárgyalt variancia, előfeltétel-vizsgálatok, rotáció és töltések értelmezésének ismerete elengedhetetlen.

A főkomponens-elemzés célja, hogy összegezzük a mért (manifeszt) változókat minél kisebb információvesztéssel (lényegkiemelés). Ehhez képest a (feltáró) faktorelemzés célja, hogy a mért változóink mögött húzódó látens struktúrát feltárjuk.

Míg a főkomponens-elemzés során a teljes varianciával számolunk (a korrelációs mátrix főátlójában 1-esek állnak), addig a feltáró faktorelemzés (EFA) bizonyos típusainál (például a főtengely-analízisnél – PAF, principal axis factoring) a közös varianciát többszörös lineáris regresszióval (SMC, squared multiple correlation) becsüljük meg előre minden változóra vonatkozóan. Más EFA módszerek (pl. Maximum Likelihood, DWLS stb.) pedig iteratív algoritmusokat használnak a paraméterek becslésére.

A faktorelemzés során csak a közös varianciák szerepelnek a korrelációs mátrix átlójában, az egyedi variancia és a hiba nem, így a ténylegesen közös varianciák közötti struktúra feltárására alkalmas.

18.1 Faktorálási eljárások

A faktoranalízis során statisztikai becslési eljárással meghatározzuk, hogy hogyan illeszkedjen a modellünk a megfigyelt korrelációs mátrixhoz. A választásnál a legfontosabb szempont a többváltozós normalitás és a változók mérési szintje; illetve hogy illeszkedési alapú vagy iteratív megközelítést választunk. Ezek olyan matematikai alapok, aminek ismeretére gyakorló pszichológusként nincs feltétlenül szükségünk, de az érdeklődők elolvashatják Tabachnick és Fidell (2019) vonatkozó 13. fejezetét.

- Klasszikus módszerek kifejezetten feltáró jellegű elemzésekhez (EFA)

Főfaktor-analízis, Principal Axis Factoring (PAF): Az EFA egyik leggyakrabban használt extrakciós módszere. A PAF iteratív eljárással becsli meg a kommunalitásokat. Nem feltételezi a változók normál eloszlását, ezért rendkívül robusztus klinikai vagy kérdőíves adatok esetén (Fabrigar és mtsai., é. n.).

Minimum Rank Factor Analysis (MRFA): Ez az eljárás azokat a faktorsúlyokat keresi meg, amelyek mellett a maradványértékek korrelációs mátrixának átlón kívüli elemeinek négyzetösszege a legalacsonyabb lesz.

χ2 alapú Maximum likelihood (ML) becslőfüggvény

A leggyakoribb általános becslőmódszer a faktoranalízisben. Szigorúan megköveteli a többváltozós normalitást és a skálaváltozókat.

A Maximum Likelihood (ML) becslés során egy Likelihood Ratio próbát végzünk, amely azt vizsgálja, hogy a modellünk által produkált kovarianciamátrix szignifikánsan eltér-e a mért értékekből készített kovarianciamátrixtól. A modellerősségi mutatókat (RMSEA, CFI és TLI) ebből a χ2 eredményből származtatjuk.

Léteznek robusztus változatai (MLM, MLR), amelyek elviselik a normalitás sérülését, de ezeket elsősorban strukturális egyenletmodellezések (SEM) során alkalmazzuk, egyszerű EFA-nál ritkábban elérhetőek.

Becslés kategorikus és ordinális adatokon (WLS család)

Pszichológiai kérdőíveknél (pl. Likert-skálák) a folytonosság és a normalitás ritkán teljesül, ezért a legkisebb négyzetek elvét használó eljárásokat preferáljuk.

Weighted Least Squares (WLS): Teljes súlymátrixot használ, és nem követeli meg a normál eloszlást. Hátránya, hogy a súlymátrix mérete a változók számával exponenciálisan nő, így stabil eredményhez extrém magas (N ≥ 1000) fős minta szükséges.

Diagonally Weighted Least Squares (DWLS): A WLS praktikusabb változata, amelyet kifejezetten ordinális adatokhoz (Likert-skálákhoz) fejlesztettek. Csak a súlymátrix átlós elemeit használja, így már (N =) 150-200 fős mintán is megbízható. Alapja polikorikus korrelációs mátrix.

Weighted Least Squares Mean-and-Variance-adjusted (WLSMV): Ez a de facto sztenderd a kategorikus változók esetén. A faktorparamétereket DWLS-sel méri, de a standard hibákat és az illeszkedési statisztikákat robusztus korrekciókkal számítja ki, így kompenzálja a normalitás hiányát.

- Egyéb speciális becslők

Unweighted Least Squares (ULS/OLS): Minden maradványértéket azonos súllyal kezel, függetlenül a változó varianciájától. Robusztus változata az ULSMV, amely akkor hasznos, ha a normalitás súlyosan sérül, és a DWLS feltételei sem állnak fenn.

Generalized Least Squares (GLS): Nagyobb súlyt ad a „precízebben” mért, azaz kisebb varianciájú változóknak. Az Maximum likelihood módszerhez hasonlóan feltétele a többváltozós normalitás. Kis mintán teljesen megbízhatatlan, ezért a gyakorlatban ritkábban alkalmazzuk.

18.2 Modellilleszkedés vizsgálata

Az alapvető modellilleszkedési mutató egy χ2 próba. Alacsony p-érték (és kimondottan szignifikáns eredmény) rossz modellilleszkedésre utal, de nagy mintaelemszámnál túlságosan érzékeny a próba. A nyers khí-négyzet próba eredménye helyett a gyakorlatban az alábbiakat vesszük figyelembe:

Khí-négyzet és szabadságfok aránya (χ2/df) < 2 kiváló illeszkedést jelez (Cole, 1987), míg < 5 érték számított elfogadhatónak korábban (Wheaton és mtsai., 1977).

Összehasonlító illeszkedés mutató (CFI, Comparative Fit Index) azt vizsgálja, hogy a feltételezett modell mennyire megfelelően tudja reprodukálni a ténylegesen mért adatainkat. Csupán 0 és 1 közötti értéket vehet fel. > 0,90 érték megfelelőnek, míg > 0,95 érték kiválónak számít (Hu és Bentler, 1999).

Tucker-Lewis Index (TLI) vagy Non-normed Fit Index (NNFI) a CFI nem normalizált változata (nem csupán 0-1 között vehet fel értéket). Kimondottan bünteti a túl komplex modelleket. Ugyanolyan kritériumértékekkel rendelkezik, mint a CFI.

Megközelítési négyzetes középérték hiba (RMSEA, Root Mean Square Error of Approximation) az illeszkedési χ2 próbát korrigálja szabadságfokkal, majd viszonyítja a szabadságfok és minta nagyságához, és ennek az aránynak a gyökét mutatja (Júlia, 2023). Az RMSEA ≤ 0,06 értéke ideális (Hu és Bentler, 1999), < 0,08 elfogadható (Browne és Cudeck, 1992). Újabb szerzők szerint < 0,7 elfogadható, míg < 0,03 érték ideális (Steiger, 2007). Újabban a 90% konfidenciaintervallumot is meg szoktuk adni, felső értékére < 0,10 a javasolt kritérium. Ez a mutató szintén érzékeny a modellek komplexitására.

Standardizált reziduális négyzetes középérték (SRMR, Standardised Root Mean Square Residual) mutató a standardizált maradványértékek (a megfigyelt és a modell által implikált korrelációk különbségeinek) átlagos mértéke. Értéke 0 és 1 között lehet. 0 a tökéletes illeszkedés. SRMR ≤ 0,08 értéke számít ideálisnak (Hu és Bentler, 1999).

Bayesiánus információs kritérium (BIC, Bayesian Information Criterion) egy összehasonlító mutató, tehát modellek közötti választás során az alacsonyabb értékűt tekintjük jobbnak. Altípusa a SABIC (Sample-Size Adjusted BIC), ami a mintaelemszámmal korrigál.

Súlyozott reziduális négyzetes középérték (WRMR, Weighted Root Mean Square Residual) az SRMR olyan változata, amelyik a varianciával súlyoz. A mintaelemszám növelésével romlik a mutató értéke. Jelenleg kevésbé gyakori a használata. <1 alatti érték számít megfelelőnek. Kategóriaváltozók esetén a WLSMV becslőmódszerrel használhatjuk.

(Korrigált) illeszkedés jósága mutató (GFI, Goodness of Fit és AGFI Adjusted Goodness of Fit) elavultnak számít. A statisztikai programok még gyakran megjelenítik, folyóiratok még kérhetik, ha kihagyjuk, de ne használjuk értékelésre.

18.3 Struktúramátrix (Structure Matrix) vs Mintázatmátrix (Pattern Matrix)

A Struktúramátrix (Structure Matrix) a változók (itemek) és a látens faktorok becsült korrelációs mátrixa, ami a szorzatmomentumot, vagyis Pearson-féle korrelációs együtthatót tartalmaz kontrollálás nélkül, tehát tartalmazza a többi faktor adott itemre értendő hatását is. Pszichometriában nem ezt használjuk.

A Mintázatmátrix (Pattern Matrix) vagy forgatott faktorsúlymátrix (rotated factor load matrix) a standardizált regressziós koefficienseket tartalmazza, ami megmutatja, hogy az adott változóra milyen közvetlen hatással van az adott faktor, miközben kontrollálunk a többi faktor hatására (l. parciális korreláció). Ferde (oblique) rotáció alkalmazásakor a struktúramátrixtól jelentősen eltér, és kimondottan a mintázatmátrix alapján állítjuk fel a modellünket és ennek az eredményét jelentjük a szakcikkben is (Osborne és mtsai., 2008).

18.4 Példa feltáró faktoranalízisre

A főkomponenselemzésről szóló fejezetben leírt példát és adatsort használjuk ismét.

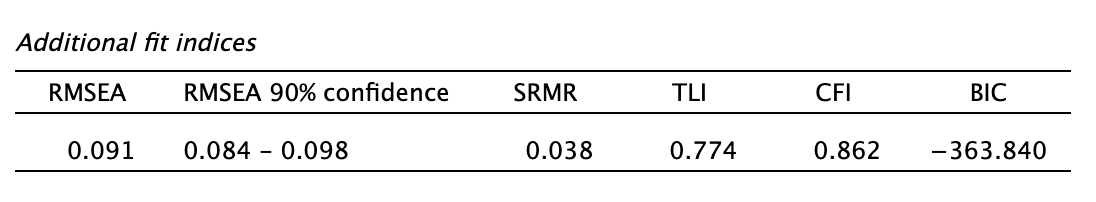

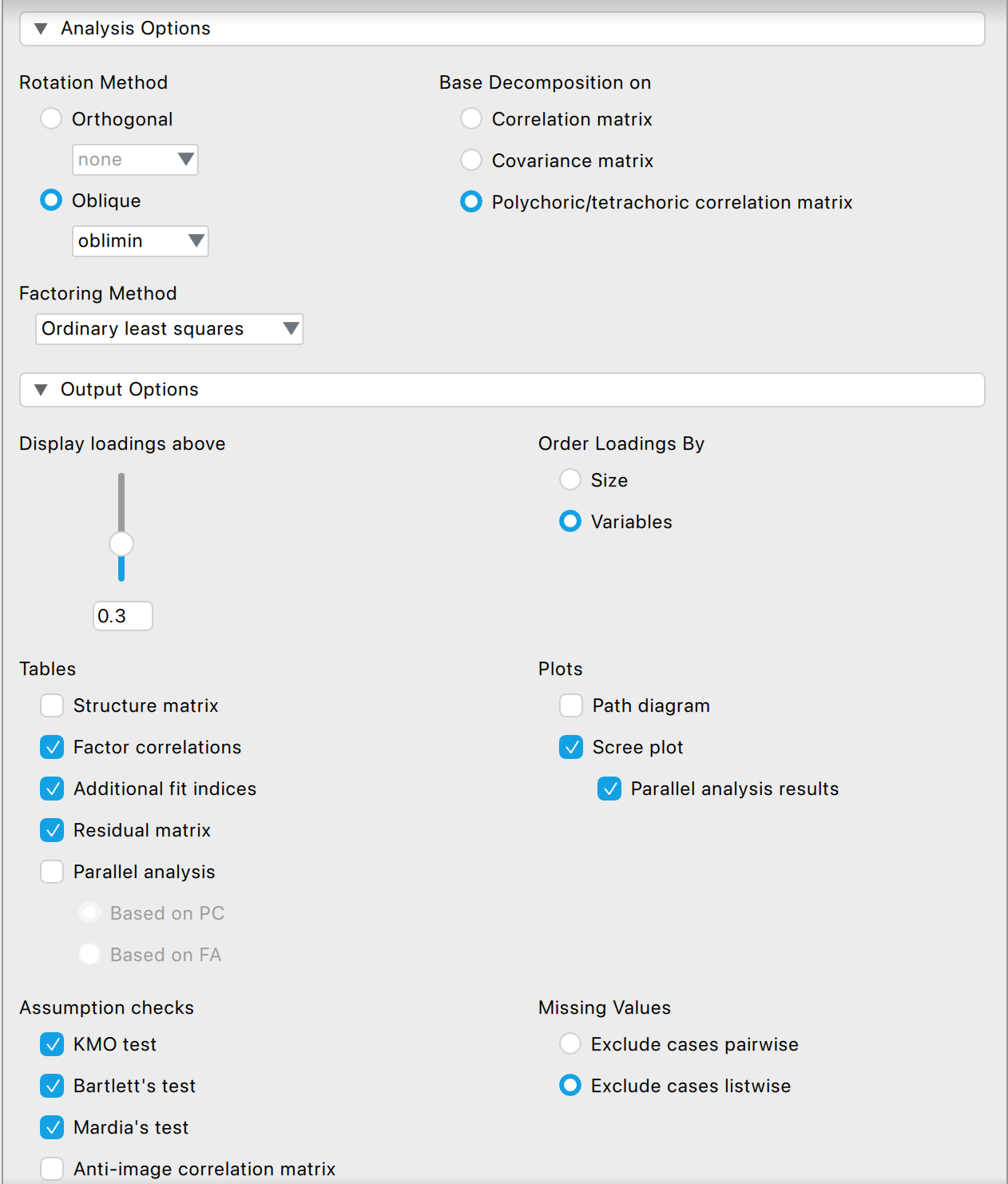

Az EFA-t a Factor / Exploratory Factor Analysis modulban végezzük el. Beállítjuk a vizsgálatot az alábbiak szerint:

- Number of factors szekcióban a Based on rovaton belül a Horn-féle parallelanalízist választjuk (Parallel analysis), azon belül pedig - mivel faktoranalízist végzünk - a FA opciót választjuk.

- Rotáció az Analysis Options szekcióban: mivel tudjuk, hogy személyiségjellemzőket vizsgálunk, és a személyiség konstruktumok között mindig van korreláció, pszichometriai módszertani hiba lenne derékszögű (ortogonális) rotációt használni. A szakmai konszenzus alapján ferde (oblique) rotációt választunk. Használjuk a most promax rotációt (Osborne és mtsai., 2008), ahogy a főkomponenselemzéses példában is.

- Az Analysis Options szekcióban a Factoring method listából válasszuk ki a megfelelő módszert majd: ha a Mardia-féle többdimenziós normalitás próba szignifikáns, akkor semmiképpen sem válaszhatunk Maximum likelihood (default) módszert, sem olyat, ahol a többdimenziós normalitás feltétel. Ordinális adatok esetén a Weighted Least Squares mód lenne megfelelő, de nagyon nagy mintaelemszám szükséges hozzá. Használhatjuk a Principal axis factoring módszert az elemzésünkhöz, ami elég robusztus.

- Mátrix kiválasztása a Base Decomposition on szekcióban: tudjuk, hogy polikorikus korrelációs mátrixot főleg ordinális adatoknál, vagy kimondottan Likert tételeknél célszerű használni. Az egyetlen jó választás, ha a Mardia-féle mutatók szignifikánsak. (Ezt később meglátjuk!)

- Az Output options szekcióban…

- állítsuk be, hogy a |0,3| fölötti komponenstöltéseket láthassuk (az alapbeállítás 0,4): Display loadings above

- állítsuk be, hogy a komponenstöltések táblázatában ne a töltések erőssége, hanem a változók nevének sorrendjében jelenjenek meg a változóink: Order Loadings By Variables

- állítsuk be, hogy a hiányzó értékeket (Missing Values) listwise töröljük! Ez esetben az elemzés minden olyan adatsort kihagy, ahol hiányzó érték szerepel. Ha a pairwise opciót választjuk, akkor több adatunk marad meg az elemzéshez, de a torzítás is nő, vagy fennáll a kockázata az inkonzisztens korrelációs mátrixok előállásának.

- pipáljuk ki a Tables rovatban a Factor correlations lehetőséget, mert ferde rotációt alkalmaztunk és tudni szeretnénk, hogy milyen korreláció áll fenn a főkomponensek között.

- pipáljuk ki a Tables rovatban az Additional fit indices lehetőséget, hogy a modellilleszkedési mutatókat kiszámítsuk.

- pipáljuk ki a Tables rovatban a Residual matrix lehetőséget, mert ellenőriznünk kell, hogy a modellünk maradványértékei alacsonyak.

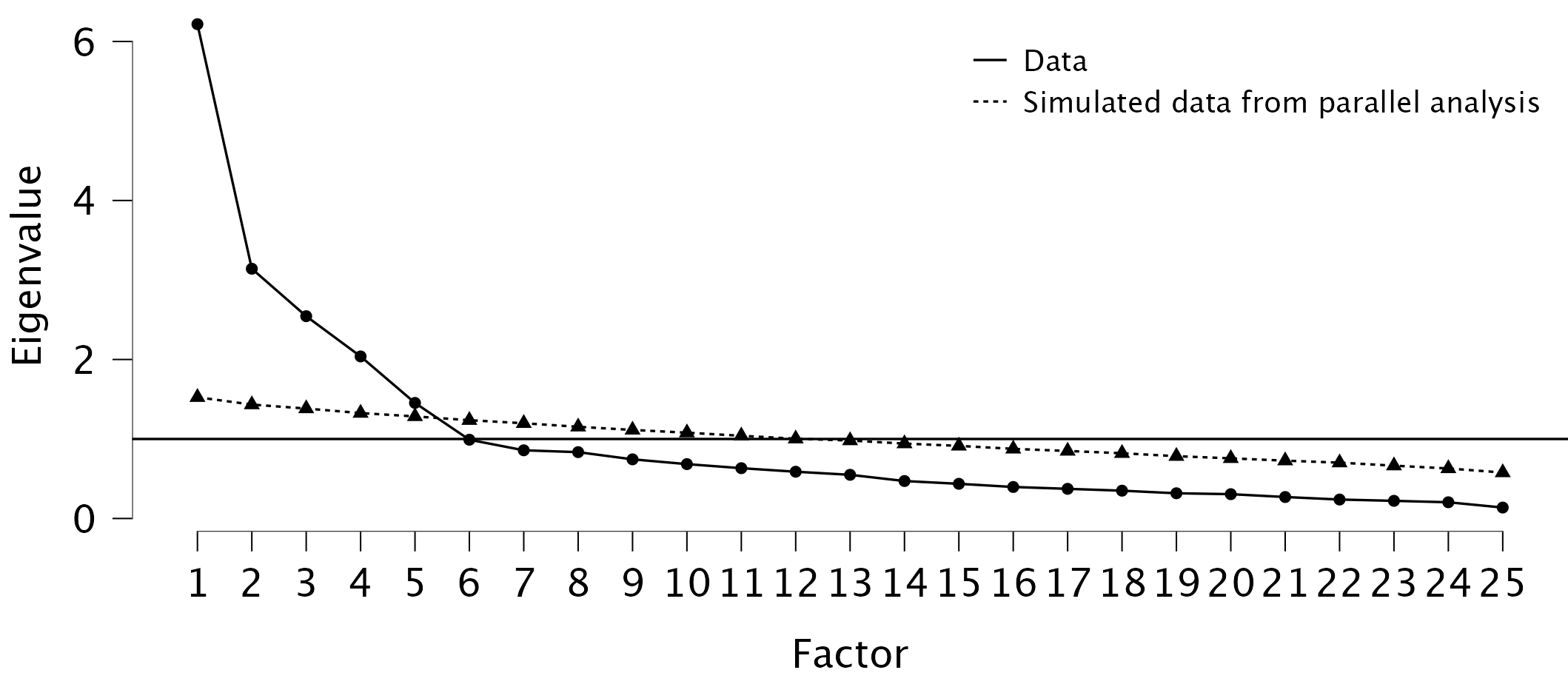

- pipáljuk ki a Plots rovatban a Scree plotot és a Parallel analysis results-t, ami alapján döntünk a megtartott komponensek számáról.

- pipáljuk ki az Assumption cheks szekció összes mezőjét, de minimum a KMO test, Bartlett’s test és FA esetén a Mardia’s test opciókat!

- Olvassuk le az előfeltétel-vizsgálatok eredményeit!

Ne lepődjünk meg, hogy hogy ugyanazokat az eredményeket kapjuk, mint a főkomponenselemzéses példánál, mert ugyanazoknak az adatoknak a redukálhatóságát és faktorálhatóságát, valamint többdimenziós normalitását vizsgáljuk. Emlékeztetőül:

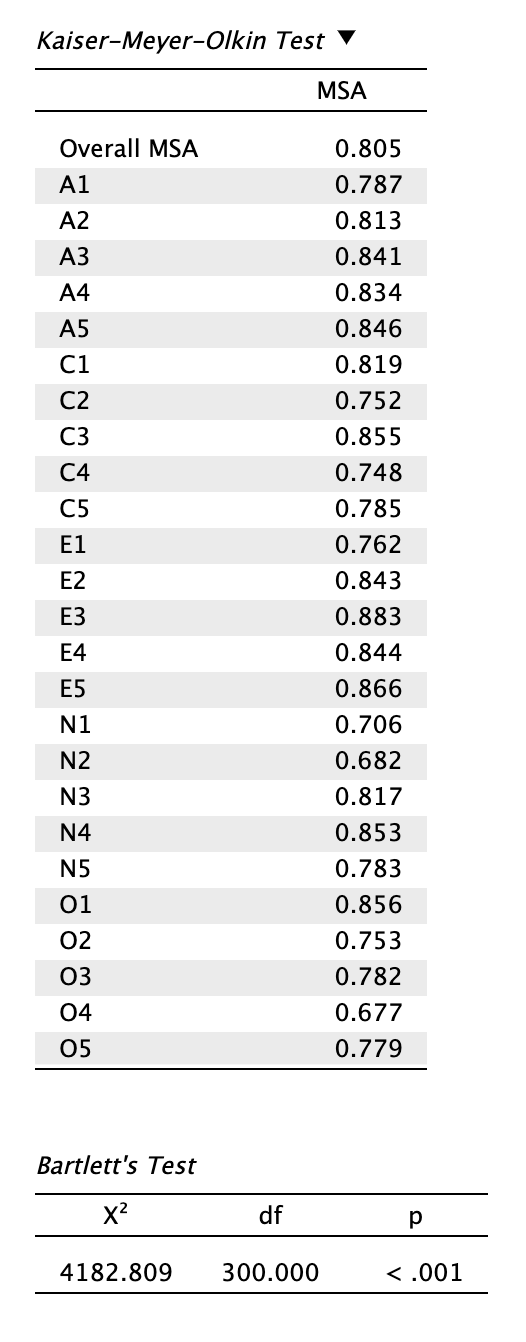

Láthatjuk, hogy a Kaiser-Meyer-Olkin-féle megfelelőségi mutató (Overall MSA) értéke 0,805, ha a polikorikus korrelációs mátrixot1 választottuk. Ez dicséretes Kaiser (1974) alapján, vagy ideális Hair és mtsai. (2019) alapján.

Az egyes tételekhez tartozó Measures of Sampling Adequacy mutatók (MSA) vegyesebb képet mutatnak: 0,677 (O4 tétel) és 0,883 (E3 tétel) között mozognak. Egyik tétel pontszáma sem 0,5 alatti, ezért nem kötelező törölnünk tételeket a modellből. Eldönthetjük, hogy kihagyjuk-e őket az elemzésből, ha erős elméleti alapunk van rá, vagy csupán jelentjük őket szövegesen. Ebben a példában értelemszerűen ez utóbbit választjuk.

A Bartlett-féle szférikusságpróba eredménye szignifikáns, vagyis a tételek közötti korreláció elégséges főkomponens-elemzéshez (és faktoráláshoz): a korrelációs mátrix nem egységmátrix.

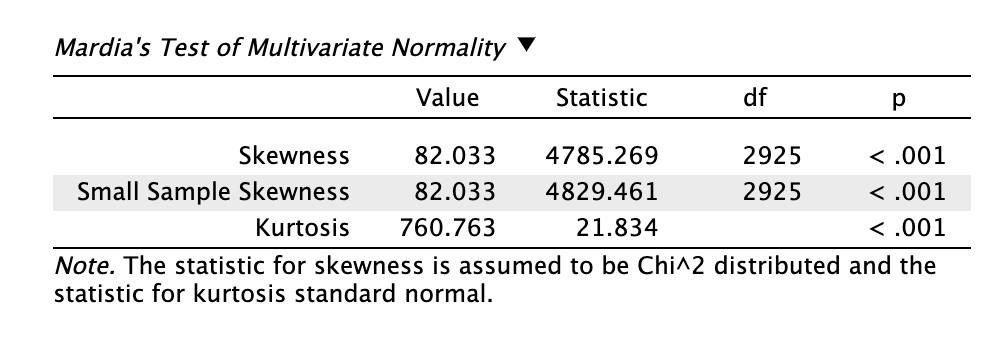

A többváltozós normalitás vizsgálata során azt látjuk, hogy mind a túlzott ferdeség, mint a túlzott csúcsosság fennáll (szignifikáns mindegyik próba). Ezért Pearson-féle korrelációs mátrixot használni nem javallot. Helyette a polikorikus korrelációs mátrix használata célszerű (nem hiába választottuk azt a biztonság kedvéért alapválasztásként).

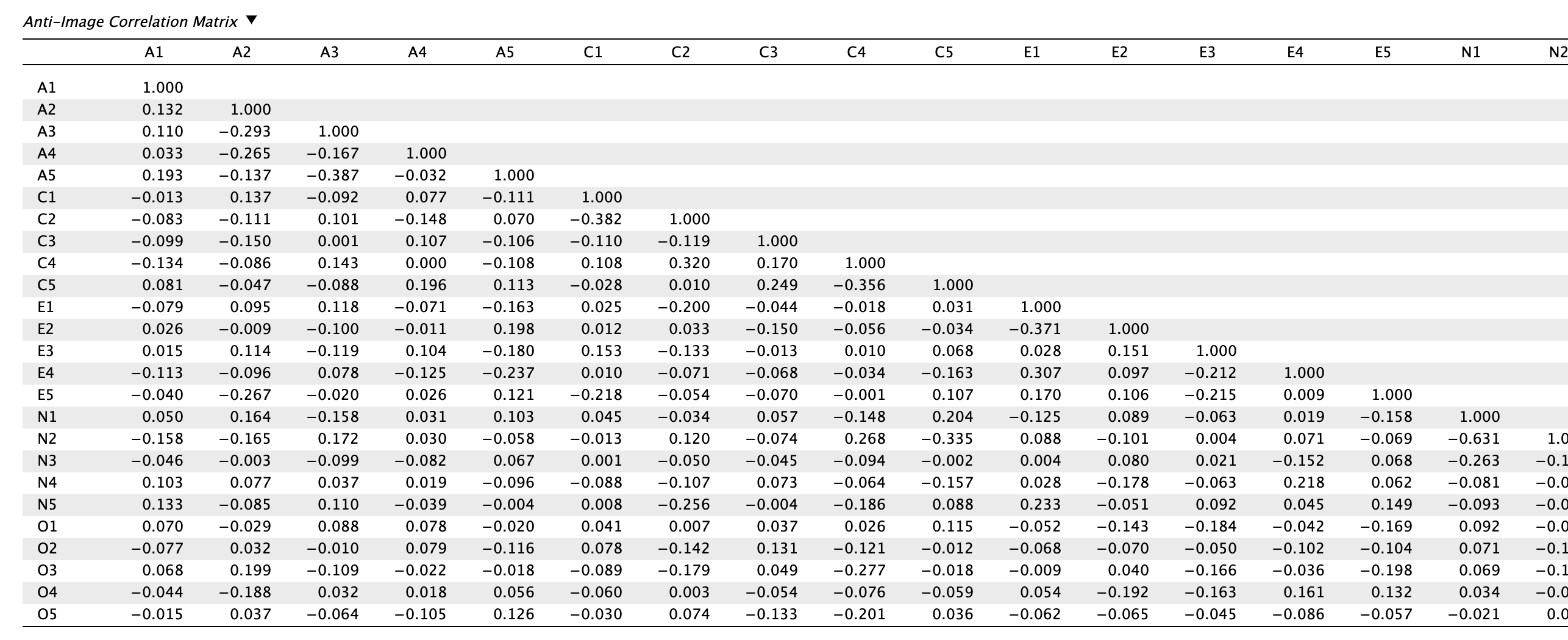

Az anti-image korrelációs mátrixot áttekintjük, és megvizsgáljuk, hogy vannak-e nullánál lényegesen nagyobb tételek (≥ 0,09) abszolút értékben. Sajnálatos módon több tételpárnál láthatunk nagyon magas parciáliskorrelációs értékeket, például:

- N1-N2: -0,631

- A3-A5: -0,387

- C1-C2: -0,382

- E1-E2: -0,371

- N3-N4: -0,368

Ez azt jelenti, hogy a mátrix jelenleg nem optimális, mert az itemek között páronként szisztematikus variancia van, amelyeket a főkomponens-elemzésben felállított főkomponensek nem fognak megfelelően lefedni, így például redundáns faktorok/komponensek állhatnak elő. Pszichometriai szempontból érdemes megvizsgálni, hogy például az N1 és N2 tételek nem mérik-e nagyon szűken ugyanazt a jelenséget.

Együttesen az előfeltételvizsgálatok azt az eredményt adják, hogy az adatstruktúra alkalmas főkomponenselemzésre (és faktoranalízisre is), az MSA értkek stabilak, bár egyes tételek túl hasonló varianciát hordoznak, ezért várhatóan nagyon magasan töltenek majd ugyanarra a komponensre.

- Nézzük meg a scree plotot és a parallelanalízis eredményét!

Láthatjuk, hogy ha pusztán a könyökábra meredekség-csökkenése alapján értékelnénk, akkor vagy két komponenst tartnánk meg, vagy hatot. Ha a Kaiser—Guttman-kritérium alapján ítélünk (eigenvalue > 1), akkor éppenhogy 5-t. A Horn-féle parallelanalízis — ami a modernebb kritérium — eredménye 5 főkomponens. (Mellékesen tudjuk, hogy a Big Five itemek 5 komponenst kellene eredményezzenek.)

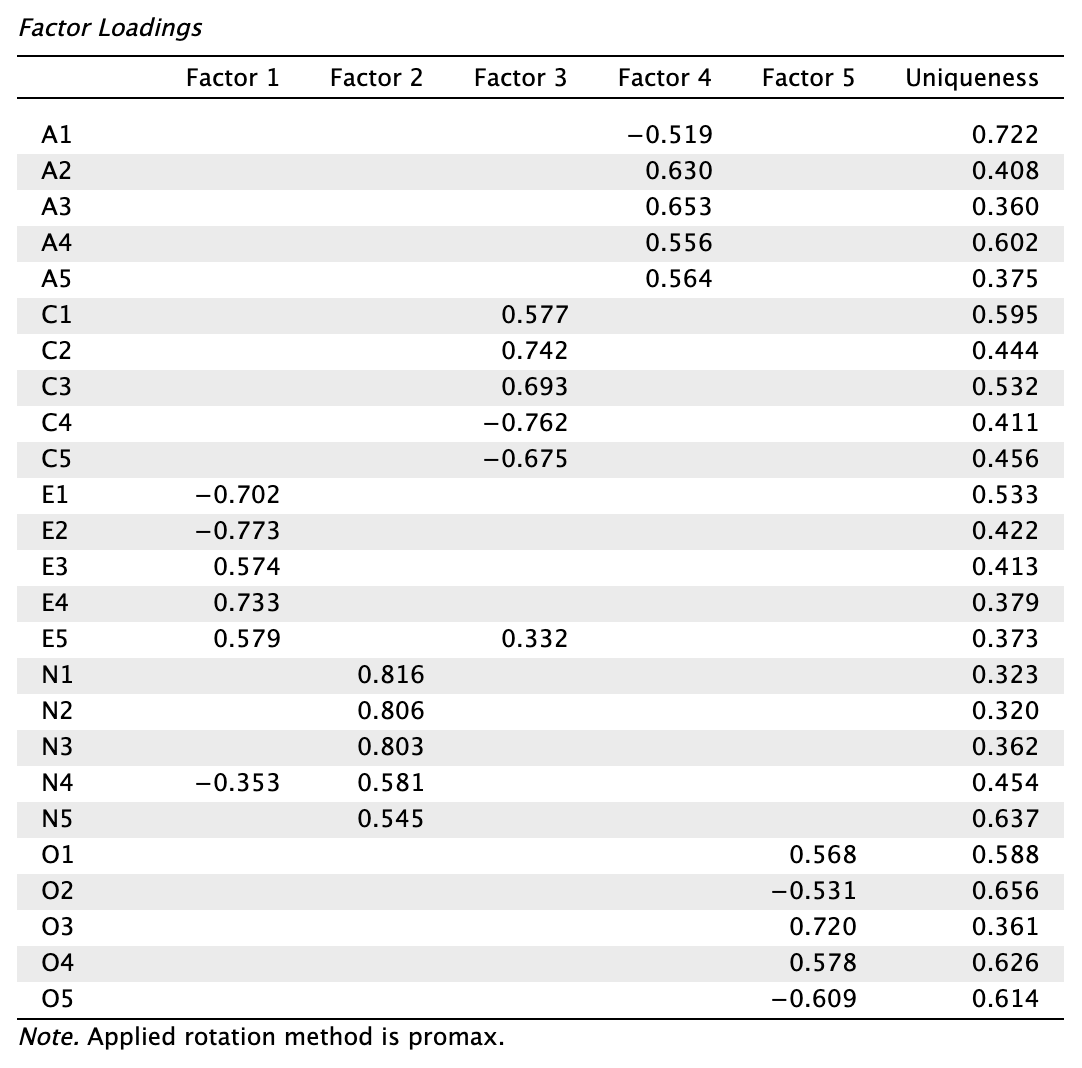

- Olvassuk le rotált töltéseket a Factor Loadings táblázatban és vizsgáljuk meg a kezdeti modellilleszkedési mutatókat is!

A Structure Matrix táblázatot nem használjuk értelmezésre, nem is pipáltuk ki. Helyette a mintázatmátrixot vizsgáljuk (JASP-ban Factor Loadings fejlécű táblázat).

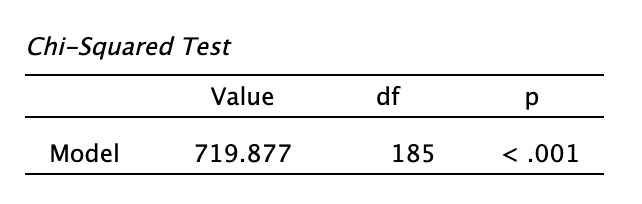

A kezdeti modellilleszkedési mutatókat az alábbiakban találjuk:

Azt vehetjük észre, hogy az SRMR értéken kívül mindegyik modellilleszkedési mutató rossz.

Vizsgáljuk meg alaposan a mintázatmátrixot. Vegyük észre, hogy a faktortöltéseink alacsonyabbak, mint PCA esetén volt. Ennél fontosabb, hogy több tétel egyedisége (Uniqueness) kritikusan magas. Emlékezzünk: magas egyediség (> 0,6) azt jelenti, hogy a változó nagy részében egyedi variancia vagy mérési hiba található, alacsony a kommunalitás. Listázzuk ki azokat a változókat, amelyeknél 0,6 fölötti egyediséget tapasztalunk (egyediség szerinti csökkenő sorrendben): A1, O2, N5, O4, O52, A4.